一、出台背景

欧盟《人工智能法案》(AI Act,法规(EU)2024/1689)是全球首个全面的人工智能法律框架,旨在通过风险分级管理,推动可信赖的人工智能发展,同时保障安全与基本权利。

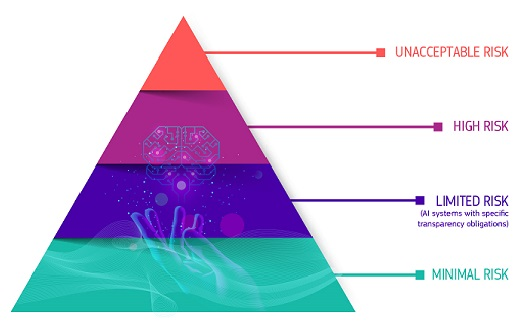

二、风险分类

- 不可接受风险:禁止类应用,如社会评分、公共场所实时人脸识别等。

- 高风险:涉及医疗、教育、公共基础设施、执法等领域,需满足安全、透明、人为监督等合规要求。

- 有限风险:需向用户明确告知使用人工智能。

- 最低风险:如垃圾邮件过滤器等,无需额外监管。

- 对通用型人工智能模型(GPAI)设有额外透明度和安全评估要求,性能极高的模型需接受更严格监督。

三、监管机制

设立欧盟人工智能办公室(AI Office)负责法规总体实施与通用型人工智能监管,成员国市场监管机构负责本国合规检查,并由欧洲人工智能委员会、科学专家组和咨询论坛协作治理。

四、配套措施

推出《通用型人工智能行为守则》(GPAI Code of Practice),指导企业在透明度、安全性、版权保护等方面建立自律机制,帮助模型提供者提前适应法规要求。

详见官网:

https://digital-strategy.ec.europa.eu/en/policies/regulatory-framework-ai